Künstliche Intelligenz und ihre Regulierung in der EU

Künstliche Intelligenz (KI) revolutioniert die Bildungswelt – von personalisierten Lernangeboten bis hin zu automatisierten Bewertungsprozessen. Doch mit den Chancen kommen auch Herausforderungen: Wie können Hochschulen sicherstellen, dass KI verantwortungsvoll und im Einklang mit gesetzlichen Vorgaben eingesetzt wird?

Die Europäische Union hat mit dem EU AI Act einen Rechtsrahmen geschaffen, der klare Leitlinien für den Einsatz von KI-Systemen vorgibt. Um Hochschulmitarbeitende bestmöglich auf diese neuen Anforderungen vorzubereiten, bietet die Hochschule Mittweida nun einen Opal-Kurs an, der die Prinzipien des AI Act vermittelt und praxisnahe Anwendungsmöglichkeiten aufzeigt. Um den Kurs zu öffnen, klicken Sie auf die Schaltfläche unten:

Was erwartet Sie im Kurs?

Der Kurs führt in die wichtigsten Aspekte des EU AI Act ein und zeigt auf, welche Bedeutung die Regelungen für die Hochschullehre haben. Sie lernen unter anderem:

- Die grundlegenden Prinzipien und Ziele des EU AI Act

- Die Einteilung von KI-Systemen nach Risikostufen

- Den Umgang mit Hochrisiko-KI-Systemen, z. B. bei der automatisierten Bewertung von Studierenden

- Maßnahmen zur Sicherstellung von Transparenz, Fairness und ethischer Nutzung von KI in der Bildung

Die Weiterbildung ist modular aufgebaut und ermöglicht es Teilnehmenden, die Inhalte eigenständig zu erarbeiten. Nach erfolgreichem Abschluss aller Tests erhalten Sie ein Zertifikat.

Sofort umsetzbare Handlungsempfehlungen

Während der Kurs eine tiefgehende Einführung in die Thematik bietet, möchten wir Ihnen an dieser Stelle bereits einige praktische Tipps an die Hand geben, damit Sie KI verantwortungsbewusst in Ihrer Forschung und Lehre integrieren können.

Wenn Sie Angehörige*r der Hochschule Mittweida sind, stehen Ihnen grundsätzlich folgende Möglichkeiten zur Verfügung:

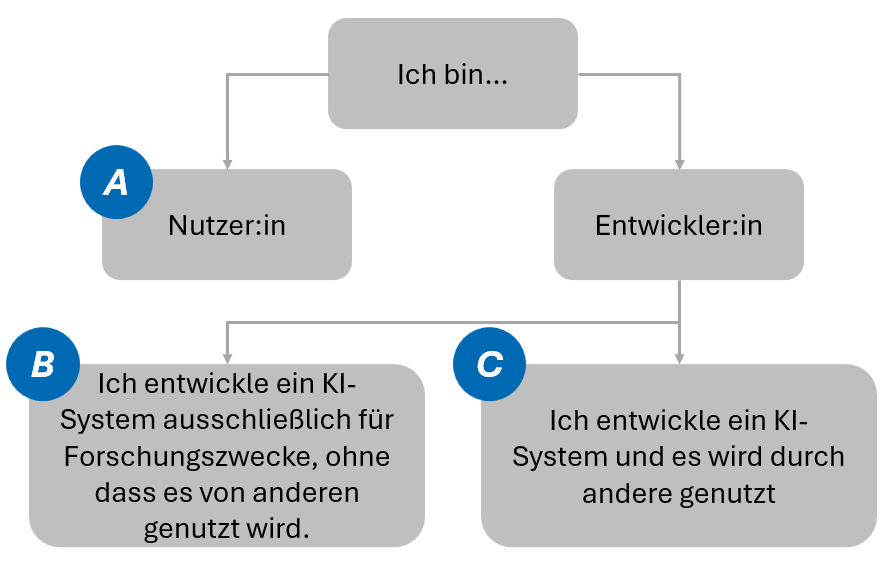

Bitte werfen Sie einen Blick auf die obenstehende Grafik. Durch die Beantwortung von zwei Fragen können Sie herausfinden, welches der folgenden drei Szenarien für Sie relevant ist.

Szenario A – Ich nutze KI-Lösungen

Wenn Sie ausschließlich Nutzer*in von KI-Systemen sind, müssen Sie sich keine Sorgen um die Einhaltung des EU AI Act machen. Wichtig ist, dass Sie sich auf von der Hochschule genehmigte Tools konzentrieren.

- Probleme melden: Falls bei der Nutzung von KI-Systemen Schwierigkeiten auftreten, informieren Sie bitte das IWD.

- KI in der Lehre einsetzen: Falls Sie KI-gestützte Technologien in der Lehre nutzen möchten, sollten Sie auf die von der Hochschule bereitgestellten und empfohlenen Lösungen zurückgreifen. Dies gewährleistet Datenschutzkonformität und eine sichere, nachhaltige Nutzung.

📌 Eine Übersicht über die von der Hochschule gehosteten oder empfohlenen Dienste

Szenario B – Ich entwickle ein KI-System ausschließlich für Forschungszwecke, ohne dass es von anderen genutzt wird

Die wissenschaftliche Forschung und Entwicklung fallen nicht unter die regulativen Einschränkungen des EU AI Act. Das bedeutet, dass die Entwicklung und Nutzung von KI-Systemen oder KI-Modellen für reine Forschungszwecke ohne Einschränkungen möglich ist.

Diese Ausnahme ist essenziell, um Innovation zu fördern, die Wissenschaftsfreiheit zu wahren und Forschungsaktivitäten nicht zu behindern. Dennoch müssen alle Forschungs- und Entwicklungsarbeiten den ethischen und professionellen Standards wissenschaftlicher Forschung sowie den geltenden EU-Vorschriften entsprechen.

Empfehlung für Hochrisiko-KI-Systeme

Auch wenn es keine verpflichtenden Regeln für eine ethische Vorabprüfung gibt, wird empfohlen, sich frühzeitig beraten zu lassen und – falls erforderlich – den kurzen Ethik-Vorabprüfungsprozess zu durchlaufen. Dies hilft dabei, potenzielle Risiken besser einzuschätzen und eine verantwortungsbewusste Entwicklung sicherzustellen.

📌 Die folgende Tabelle bietet eine Übersicht über die Kategorisierung von KI-Lösungen nach Risikostufen. Sie kann Ihnen dabei helfen, einzuschätzen, ob Ihr KI-System als Hochrisiko-KI eingestuft werden könnte:

| General-Purpose AI Systems (GPAI) | Minimales Risiko („minimal risk“) | Geringeres Risiko („limited risk“) | Hohes Risiko („high risk“) | Unzulässige Risiken („unacceptable risk“) | |

| Beispiele für KI-Systeme | Besonders große KI-Modelle und -Systeme, die für verschiedene Aufgaben eingesetzt und in Anwendungen integriert werden können (z. B. LLMs) | Spamfilter, Empfehlungssysteme, Rechtschreibprüfung, Übersetzer, Sprache-zu-Text | Chatbots, Deepfakes, generative KI zum Zweck, die Öffentlichkeit über Themen von öffentlichem Interesse zu informieren | Profiling natürlicher Personen, biometrische Identifizierung, Festlegung des Bildungszugangs, Lernbewertung, Tools für Personalrekrutierung – Ein KI-System kann auch eine Sicherheitskomponente eines Produkts sein oder selbst ein Produkt, das von anderen EU-Vorschriften erfasst und von Dritten bewertet wird (z. B. Medizinprodukte, Spielzeug, Maschinen etc.). | Täuschung, Ausnutzung von Schwachstellen, Social Scoring, Kriminalitätsvorhersage, Erkennung bzw. Ableitung von Emotionen am Arbeitsplatz oder in der Schule, biometrische Kategorisierung besonderer Kategorien personenbezogener Daten. |

Szenario C – Ich entwickle ein KI-System und es wird durch andere genutzt

Sobald Sie Ihr KI-Modell oder -System öffentlich zugänglich machen oder anderen zur Nutzung bereitstellen, können rechtliche Verpflichtungen gemäß dem EU AI Act und weiteren geltenden Vorschriften entstehen.

Die spezifischen Anforderungen hängen davon ab, welcher Risikostufe Ihr KI-System oder KI-Modell zugeordnet wird. Je nach Einstufung können unterschiedliche Transparenz-, Sicherheits- und Dokumentationspflichten bestehen.

📌 Die folgende Tabelle gibt Ihnen einen Überblick über die rechtlichen Verpflichtungen je nach Risikostufe Ihres KI-Systems:

| Allgemeine KI-Modelle | Minimales/kein Risiko KI-System | Begrenztes Risiko KI-System | Hochrisiko KI-Systeme | Verbotene KI-Praktiken | |

| Rechtliche Verpflichtungen | Unterschiedliche rechtliche Verpflichtungen gelten – bitte Kontakt mit der Datenschutzbeauftragten aufnehmen | Informations- und Transparenzpflichten | Keine Verpflichtungen | Informations- und Transparenzpflichten | Sie müssen verschiedene Verpflichtungen gemäß dem AI Act einhalten. Wenden Sie sich an die Datenschutzbeauftragten |

| Ethische Empfehlungen | Eine ethische Vorabprüfung ist optional und liegt im Ermessen der Forschenden. | Keine ethische Vorabprüfung erforderlich. | Eine ethische Vorabprüfung wird empfohlen. | Eine ethische Vorabprüfung wird empfohlen. | Eine ethische Vorabprüfung wird dringend empfohlen. |

Bitte beachten Sie, dass Sie möglicherweise ein „Anbieter“ sind (wenn Sie ein KI-System erstellt oder modifiziert und für andere zugänglich gemacht haben) oder ein „Betreiber“ (wenn Sie ein externes KI-System für andere installieren): Unterschiedliche rechtliche Verpflichtungen gelten